Un progetto troppo grande per essere gestito: “Ho dovuto lasciare!” | Pericolo concreto per tutto il genere umano

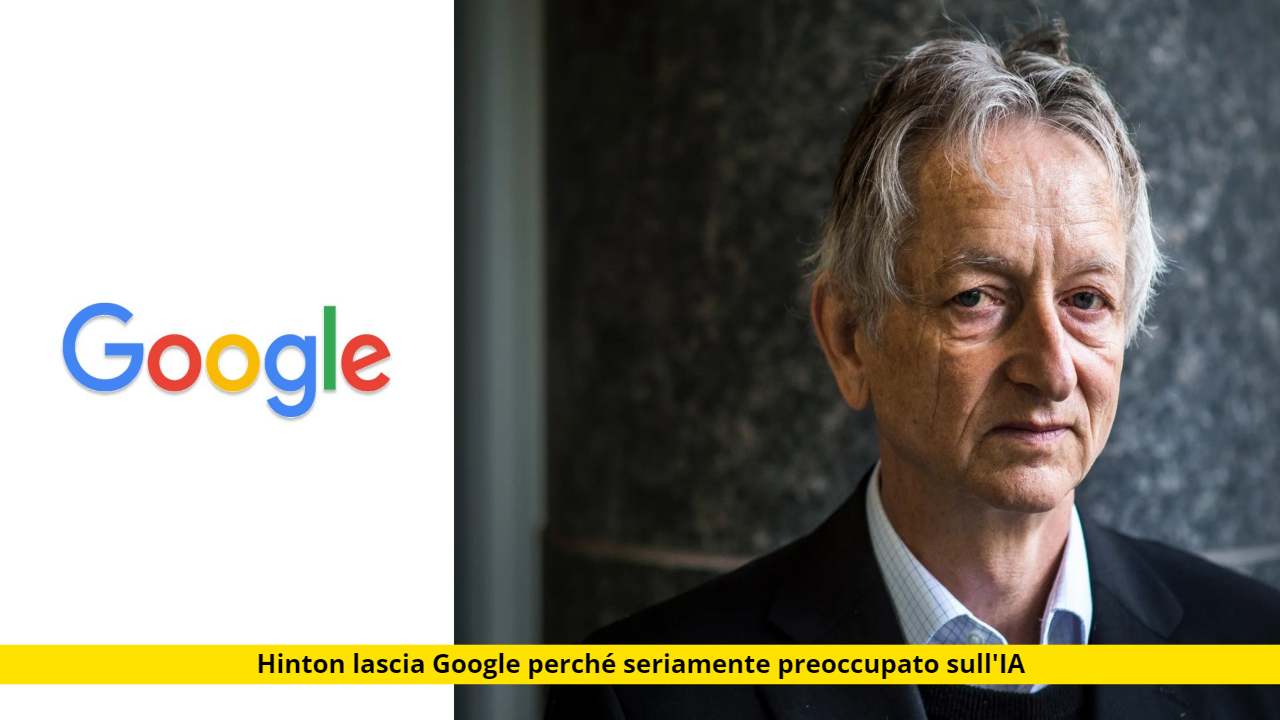

Il padre fondatore dell’IA Geoffrey Hinton lascia la società di Google, poiché ritiene che il suo stesso progetto stia “sfuggendo di mano”.

Geoffrey Hinton, considerato il padrino dell’intelligenza artificiale (IA), ha lasciato il suo lavoro presso Google dopo dieci anni di collaborazione. Il motivo della sua decisione è la crescente preoccupazione per i possibili pericoli derivanti dai progressi nel campo dell’IA, che potrebbero minacciare l’umanità. Nel dettaglio, ha spiegato che “me ne sono andato per poter parlare dei suoi pericoli”, ma che, nonostante le circostanze, secondo lo scienziato “Google ha agito in modo molto responsabile”.

Hinton, che ha vinto il Premio Turing nel 2018 per i suoi contributi alla ricerca sull’IA, ha dichiarato di voler poter parlare liberamente dei rischi delle intelligenze artificiali senza dover tenere conto dell’impatto delle sue parole su Google, che ha definito, per l’appunto, una società responsabile. Hinton è noto per aver sviluppato algoritmi di apprendimento automatico innovativi, come le reti neurali profonde, che hanno rivoluzionato il riconoscimento vocale e la classificazione degli oggetti.

Il suo obiettivo è scoprire un procedimento di apprendimento che sia efficiente nel trovare strutture complesse in grandi dataset ad alta dimensionalità e dimostrare che questo è il modo in cui il cervello impara a vedere. Hinton ha espresso il timore di aver contribuito a creare un’arma che potrebbe spazzare via l’umanità, paragonandosi a Robert Oppenheimer, lo scienziato che aiutò gli Stati Uniti nello sviluppo della bomba atomica.

In merito alla questione del pericolo dell’intelligenza artificiale, Hinton ha dichiarato che “in questo momento, quello che stiamo vedendo è che cose come GPT-4 oscurano una persona nella quantità di conoscenza generale che ha e la oscura di gran lunga. In termini di ragionamento, non è così buono, ma fa già un semplice ragionamento. E dato il ritmo dei progressi, ci aspettiamo che le cose migliorino abbastanza velocemente. Quindi dobbiamo preoccuparcene”.

Ma quali sono, ad oggi, i rischi concreti dell’IA?

Uno dei rischi dell’IA è quello relativo alla privacy e alla sicurezza dei dati. L’IA utilizza grandi quantità di dati per apprendere e migliorare le sue funzioni, ma questi dati possono essere violati, alterati o usati in modo improprio da attori malintenzionati.

Ad esempio, i dati raccolti dai social media possono essere usati per identificare le persone, monitorare le loro attività e influenzare le loro decisioni. Inoltre, l’IA può essere usata per creare false immagini o video, che possono portare a conseguenze gravi come la manipolazione dell’opinione pubblica.

Un altro rischio dell’IA è quello della perdita di posti di lavoro. L’IA e l’automazione possono portare alla sostituzione di molti lavoratori in diversi settori. Ad esempio, l’automazione delle fabbriche e delle attività di servizio può portare alla disoccupazione di massa. Questo potrebbe avere effetti negativi sull’economia, sulla coesione sociale e sul benessere delle persone.